Erste Teile der KI-Verordnung sind in Kraft getreten

Künstliche Intelligenz (KI) wird im Arbeitsprozess verwendet; sei es um mit KI unterstützt Emails zu beantworten, Logistik zu bewältigen, Kundenkontakte und Kampagnen zu organisieren, Beschäftigte zu schulen und weiterzubilden und vieles mehr. In der EU wird der Einsatz dieser Technologie gesetzlich reguliert: mit der Verordnung zur Vorlegung fester Vorschriften zur Nutzung Künstlicher Intelligenz, kurz: dem AI-Act . Was sind die wichtigsten Punkte des seit Kurzem geltenden Gesetzes? Welche KI-Systeme sind erlaubt? Darf KI die Gefühle von Menschen analysieren? Und was halten die Europäischen Sozialpartner von alldem?

Erste Teile der KI-Verordnung sind ab Februar 2025 in Kraft getreten. Bestimmte KI-Systeme dürfen seitdem nicht mehr verwendet werden (Art 5 AI Act). Damit soll Diskriminierung ausgeschlossen werden. Dezidiert verboten sind nun Systeme, die mittels KI die Emotionen von Beschäftigten erkennen wollen. Die Umsetzung dieses Verbots könnte spannend werden, da beispielsweise im Bewerbungsprozess oder in Call-Centern derartige KIs durchaus auf dem Markt erhältlich sind.

Keine KI zur Emotionserkennung im Arbeitsverhältnis

Ab dem 02.02.2025 ist folgende KI in der Europäischen Union verboten:

- KI-Systeme die manipulieren: KI-Systeme, die durch unterschwellige, manipulative oder täuschende Techniken das Verhalten von Einzelpersonen oder Gruppen erheblich beeinflussen, indem sie deren Entscheidungsfähigkeit beeinträchtigen.

- KI-Systeme die Schwachstellen ausnutzen: z. B. Schwachstellen von Personen aufgrund von Alter, Behinderung oder sozioökonomischer Situation um damit deren Verhalten zu beeinflussen.

- Soziale Bewertungssysteme (“Social Scoring”): Bewertung oder Klassifizierung von Personen aufgrund ihres sozialen Verhaltens,

- KI-Systeme die Kriminalität durch Profiling prophezeien (“predictive policing”): Risikobewertungen, die ausschließlich auf Profilen oder Persönlichkeitsmerkmalen beruhen, um Straftaten vorherzusagen. Ausnahmen sind Systeme zur Unterstützung menschlicher Entscheidungen auf der Grundlage objektiver Beweise.

- Gesichtserkennungsdatenbanken: in denen ungezielt Bilder aus dem Internet oder durch Videoüberwachung gesammelt werden

- KI-Systeme die Emotionen am Arbeitsplatz oder in Bildungseinrichtungen analysieren: Ausnahme sind medizinische oder Sicherheitszwecke.

- KI-Systeme die biometrische Kategorien erstellen: um auf ethnische Zugehörigkeit, politische Einstellung, Gewerkschaftszugehörigkeit, Religion oder sexuelle Orientierung rückzuschließen. Eine Ausnahme besteht für Strafverfolgungsbehörden bei der Analyse rechtmäßiger Datensätze

- Biometrische Fernidentifizierungssysteme in Echtzeit: deren Einsatz ist im öffentlichen Raum verboten. Ausnahmen sind die Suche nach vermissten Personen, die Abwehr terroristischer Gefahren und die Identifizierung von Straftätern (unter strengen Auflagen).

Sollte gegen diese Verbote verstoßen werden, drohen empfindliche Strafen von bis zu 35 Millionen Euros oder 7 % des weltweiten Umsatzes.

Wer genau feststellt, ob ein System als Hochrisiko einzustufen ist, welche exakten Kriterien dafür zu verwenden sind und wie das Verbot überprüft werden soll, ist allerdings (noch) nicht ganz klar.

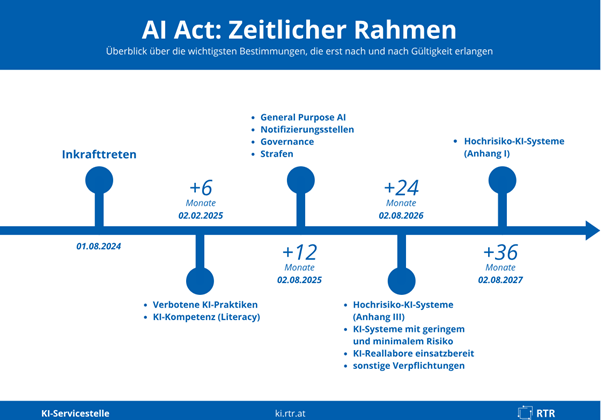

Klar ist, dass weitere Teil der KI-Verordnung Stück für Stück in Kraft treten, damit ausreichend Vorbereitungszeit gegeben ist.

KI-Verordnung tritt Stück für Stück in Kraft

(C) RTR https://www.rtr.at/rtr/service/ki-servicestelle/ai-act/Zeitplan.de.html

Im Europäischen Wirtschafts- und Sozialausschuss (EWSA) hat man sich klar für eine bessere Regulierung von KI am Arbeitsplatz ausgesprochen.

mehr Mitsprache bei KI am Arbeitsplatz

Zwar gab es einige Gegenstimmen seitens der Arbeitgeberseite doch nahm das höchste Europäische Gremium der Sozialpartner eine Resolution an, der gemäß die Sozialpartnerschaft beim Einsatz von KI mehr Einfluss haben sollen.

Im EWSA war Roxana Mînzatu, zuständige EU-Kommissarin für Angelegenheiten rund um Beschäftigung, Bildung und soziale Rechte, zu Gast. Sie hat ihre Unterstützung für die Umsetzung von zentralen Punkten der Stellungnahme zugesagt. So soll es einen verstärkten sozialen Dialog bei der Einführung von Hochrisiko-KI-Systemen geben. Es sollen klarere Regeln für Hochrisiko-Systeme gelten sowie verpflichtende Folgenabschätzungen. Außerdem müssten die Regeln der Plattformarbeitsrichtlinie auf alle von algorithmischer Steuerung betroffenen Arbeitnehmer:innen ausgeweitet werden und so Arbeitnehmer:innen davor schützen, dass Daten aus ihrer Arbeitsleistung automatisch zu KI-Trainingsdaten werden.

Meanwhile in Paris…

Beim KI-Gipfel standen in Frankreich vorwiegend die Errungenschaften und Potentiale von KI im Fokus und das Bemühen Europas, das bei diesem Battle definitiv nicht zur Spitze zu zählt (was ist schon Audrey im Vergleich zu ChatGPT oder Deep Seek?), in der KI-Entwicklung aufzuholen. EU-weit möchte man endlich auf die Schnellspur kommen. Dazu dürfte die Meinung vorherrschen, dass weniger Regulierung für mehr Innovation sorge. Der internationale Gewerkschaftsbund war bei dem Treffen dabei und forderte dazu auf, Mitsprache und Mitbestimmung auf die Agenda zu setzen, wenn es um KI geht.

Die Gewerkschaft GPA bietet Informationen, Checklisten und Hilfestellung zu KI am Arbeitsplatz.

Im Newsletter der Interessengemeinschaften der IT-Beschäftigten der Gewerkschaft GPA findet ihr weiteres zur KI-Verordnung. Schaut vorbei, meldet euch beim IG IT – Newsletter an oder werdet sogar Mitglied und kandidiert für den Bundesausschuss. Dort können wir uns weiter über KI, deren rechtliche Einordnung, berufliche Auswirkung und praktische Anwendung unterhalten.