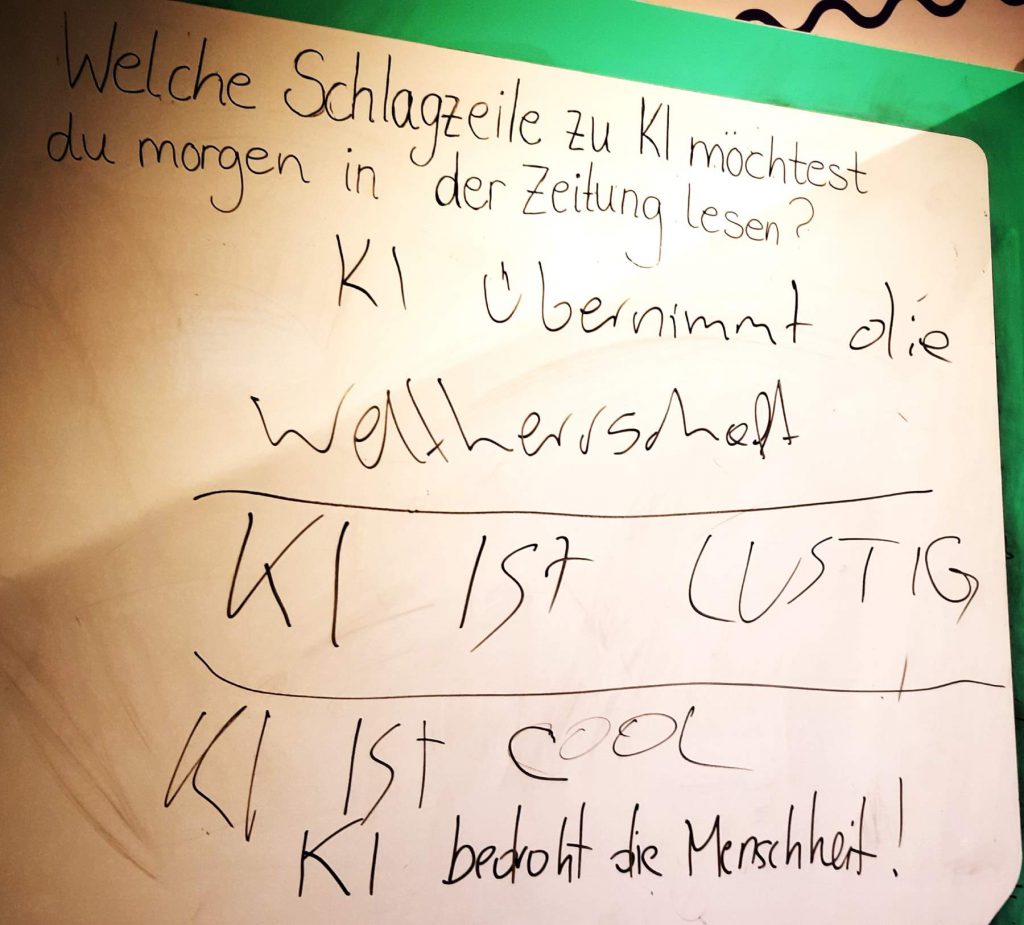

was das Schlagwort “Künstliche Intelligenz” im Arbeitsleben zu suchen hat und wie der Betriebsrat sich einbringen kann

Wer erinnert sich noch an LaMDA (Language Model for Dialogue Application) von Google? Wer befasst sich mit ChatGPT (General Pre-Trained Transformer), entwickelt von Open AI unter großzügiger Beteiligung von Microsoft? Jetzt, wo doch gerade Bard von Google seit Juli 2023 auch in Österreich auf deutsch in Stellung gebracht wird? Jemand ausgestiegen? Es handelt sich bei den erwähnten Programmen LaMDA, ChatGPT und Bard um riesige Datenmengen beinhaltende, text- bzw. sprachbasierte, über Jahre hinweg entwickelte und trainierte, (zumindest eine Zeit lang) öffentlich zugängliche “Künstliche Intelligenz”.

Entsprechend der höheren Frequenz an Berichterstattung und den mitunter höheren Aktienwerten, die die beiden Buchstaben “KI” mit sich bringen, verpassen immer mehr Unternehmen ihren Produkten das “KI-Label”. Glaubte man den Firmen, die angeben “Künstliche Intelligenz” sei in ihren Produkten enthalten, dann nutzen der überwiegende Teil der Arbeitnehmer:innen täglich in den verschiedensten Situationen eine “KI”.

- Das Navi schlägt vor, wie der morgendliche Stau effizient zu umfahren ist.

- Das Email-Programm schlägt automatisch Antwortmöglichkeiten vor und erstellt eine Reihenfolge der wichtigsten Kontakte, deren Anfragen also eher gestern als morgen zu beantworten sind.

- Das Info-Portal schlägt jene Nachrichten vor, die für den beruflichen Kontext unerlässlich sind um auf dem Laufenden zu bleiben.

- Die Foto-App schlägt das ideale Schlagwort für die Zuordnung des eben angefertigten Screenshots eines Planungsdetails vor.

- Die Präsentations-Software gibt Ratschläge für das morgige Meeting, wie das Publikum noch mehr beeindruckt werden könnte.

- Die digitale Lernplattform zeigt an, welche Kurse und Videos keinesfalls versäumt werden sollten.

- Die Bewerbungs-Plattform sortiert, wer am besten in das neue Team passt und somit Aufnahmechancen hat.

- Die Customer-Relationship-App schlägt vor, welche Kund:innen demnächst unbedingt kontaktiert werden sollten.

- Der Chatbot der Hausbank, bei der die verloren gegangene Kreditkarte gesperrt werden muss, leitet passgenau für den einzelnen Kunden und absolut sicher durch das Prozedere.

- Die App zur Essenszustelllung, die für die Mittagspause in Anspruch genommen wird, verteilt die Lieferungen je nachdem, wie Kund:innen die Fahrer:innen beurteilen.

- Die interne Karriere-Software schlägt vor, wer als nächstes einen Bonus erhalten sollte – und wer nicht.

In jedem Arbeitsalltag sind “Künstliche Intelligenzen” zu finden – oder zumindest Algorithmen, die von den sie vermarktenden Firmen als solche bezeichnet werden. Wie genau die “KI” herausfindet, was effizient, wichtig oder beeindruckend ist, bleibt eher unsichtbar. Was sichtbar gemacht wird ist, dass “KI” eingesetzt wird.

die “KI” weiß was du “brauchst”

Um nicht in den Verdacht zu geraten, strikte Vorgaben mittels KI zu erstellen oder gar “automatisierte Entscheidungsfindung” zu betreiben, die gemäß Artikel 22 DSGVO ohnehin nicht einfach erlaubt wäre, stehen die Ergebnisse dieser meist eher intransparenten Datenauswertungen als freiwilliges Angebot, als Vorschlag, als Empfehlung, als unverbindliche Information und Hilfestellung zur Verfügung, die die Letztentscheidung selbstverständlich immer dem Menschen überlasse. Maschinell erstellten Vorschlägen haftet der Nimbus der Objektivität an und seien sie noch so intransparent, sodass sie tendenziell eher befolgt als hinterfragt werden.

Abgesehen von den unklaren Parametern, die in die Darstellungen einfließen, abgesehen von den unklaren Zwecken, wozu die Ergebnisse dienen, und einmal ganz abgesehen davon, welche Rechtsgrundlage für die Verwendung dieser Ergebnisse im Arbeitsverhältnis besteht, stellt sich auch die Frage, was denn technisch betrachtet eine “Künstlichen Intelligenz” ist.

Eine einheitliche, allgemein verständliche und rechtlich bindende Definition von KI fehlt bislang. Damit von “KI” gesprochen werden kann, sollte die Anwendung über einfache Häufigkeitsauszählungen, wenn-dann-sonst-Funktionen oder die Berechnung von Korrelationen und Wahrscheinlichkeiten hinausgehen. Bei “KI” handelt es sich in der Welt der Programmierer:innen in der Regel um ein trainiertes (und zwar mit einer möglichst großen Datenmenge), ein indeterminiertes (also nicht jedes Ereignis zu hundert Prozent vorherbestimmendes), selbst-referentielles (also auf Basis der eigenen Ergebnisse weiter rechnendes) mathematisches Modell. Das Weiter-Verwenden der bereits errechneten Ergebnisse wird auch als “Machine Learning” bezeichnet. Das Verwenden von Funktionen in mehreren Schichten nennen Programmierer:innen auch in Anlehnung an das menschliche Gehirn “neuronale Netzwerke”. Diese können aus bis zu mehreren Millionen Teilfunktionen und Parametern bestehen. Machine Leaning und / oder neuronale Netzwerke sind Teile bei der Programmierung “Künstlicher Intelligenz”.

“KI” ein unklarer Begriff

Die Europäische Kommission definiert in ihrem Gesetzesentwurf, dem AI-Act, künstliche Intelligenz sehr umfassend; von der Wissensdatenbank über das unbeaufsichtigte Maschinenlernen bis zu statistischen Suchmethoden ist alles enthalten:

(a) Ansätze des maschinellen Lernens, einschließlich überwachter, unbeaufsichtigter und verstärkenden Lernens unter Verwendung einer Vielzahl von Methoden, einschließlich Deep Learning;

(b) Logik- und wissensbasierte Ansätze, einschließlich Wissensrepräsentation,

induktive (logische) Programmierung, Wissensdatenbanken, Inferenz- und Deduktionsmaschinen, (symbolische) Argumentations- und Expertensysteme;

(c ) Statistische Ansätze, Bayes’sche Schätzung, Such- und Optimierungsmethoden

Das hilft in der betrieblichen Anwendung nur begrenzt. Hilfe liefert der derzeit in Verhandlungen zwischen Europäischem Parlament und Kommission befindliche AI-Act indem er bestimmt, dass Anwendungen kategorisiert werden müssen und hochrisikoreiche “KI” nicht im Arbeitszusammenhang eingesetzt werden darf.

Ist Mitbestimmung drin, wenn KI drauf steht?

Damit von Seiten des Betriebsrats beurteilt werden kann, ob er seine Mitspracherechte ausüben muss, ob eine Folgenabschätzung oder eine Betriebsvereinbarung erforderlich ist, ob seine Informationsrechte eingehalten wurden, ob Mitbestimmung drin ist, wo KI draufsteht, hat die Gewerkschaft GPA wesentliche Fragen zusammengestellt.

- Zu welchem Zweck wird die Software verwendet?

- Welche Aussagen soll die Software treffen?

- Auf welche Daten greift die Software zu um die Aussagen zu treffen? Welche Daten stammen aus dem Unternehmen und welche wurden von Dritten übernommen? Auf Basis welcher Daten kommen die Ergebnisse zustande?

- Welche Entscheidungen sollen mittels des Programms gefällt werden? Nach welchen Kriterien entscheidet die Software? Es müssen Begründungen für die verwendeten Kriterien vorliegen, die verständlich sind.

- Welche Trainingsdaten wurden verwendet? Passen Trainingsdaten mit dem Verwendungszweck des Systems und den Anwendungsfällen im Betrieb zusammen? Wie wurde gegen Diskriminierung oder andere ungewollte Einflüsse aus den Trainingsdaten gesichert?

- Wie werden die Mitbestimmungsrechte des Betriebsrats eingehalten?

- Wer ist verantwortlich (z. B. Abteilung, Person)? An wen kann sich der Betriebsrat oder Arbeitnehmer:innen mit inhaltlichen Fragen wenden (z. B. Programmierer:innen in der IT-Abteilung, externer Dienstleister)?

- Welche Qualifikationen braucht es auf Seiten der Anwender:innen? Gibt es einen Schulungsbedarf?

- und Last but not Least: Gibt es eine Datenschutzfolgenabschätzung (gemäß Artikel 35 DSGVO)?

Einen umfassenden Leitfaden mit Fragen zur Anwendung von Künstlicher Intelligenz im Betrieb erhalten Betriebsräte der Gewerkschaft GPA bei den betriebsbetreuenden Kolleg:innen oder ihr kontaktiert das Service-Center.